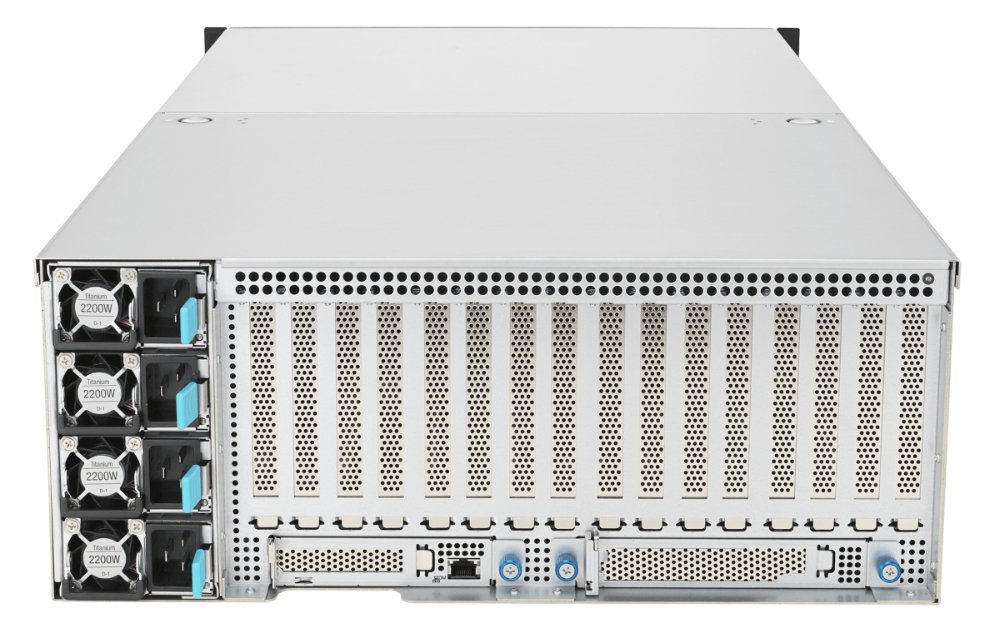

AIME A8000 - Multi GPU HPC Rack Server

Der AIME A8000 Enterprise Deep Learning-Server basiert auf dem ASUS ESC8000A-E11 Barebone. Im 4HE-Formfaktor ist er mit bis zu acht der fortschrittlichsten Deep Learning-Beschleuniger bzw. GPUs konfigurierbar.

Treten Sie ein ins Peta-FLOPS-HPC Zeitalter mit mehr als 8 Peta-TensorOps Deep Learning-Leistung: Dual-EPYC-CPUs mit bis zu 2 TB Hauptspeicher, PCIe 4.0 Bus Geschwindigkeit sowie bis zu 100 GBE Netzwerkkonnektivität.

Gebaut, um rund um die Uhr in zuverlässigstes Hochleistungs-Computing bereitzustellen. Wahlweise in Ihrem hauseigenen Rechenzentrum, Co-Location oder als Hosting Lösung.

AIME A8000 - Deep-Learning-Server

Wenn Sie einen Server suchen, der auf maximales Deep-Learning-Training, Inferenzleistung und höchste Ansprüche im HPC-Computing spezialisiert ist, haben Sie mit dem AIME A8000 Multi-GPU 4HE Rack-Server die optimale Lösung gefunden.

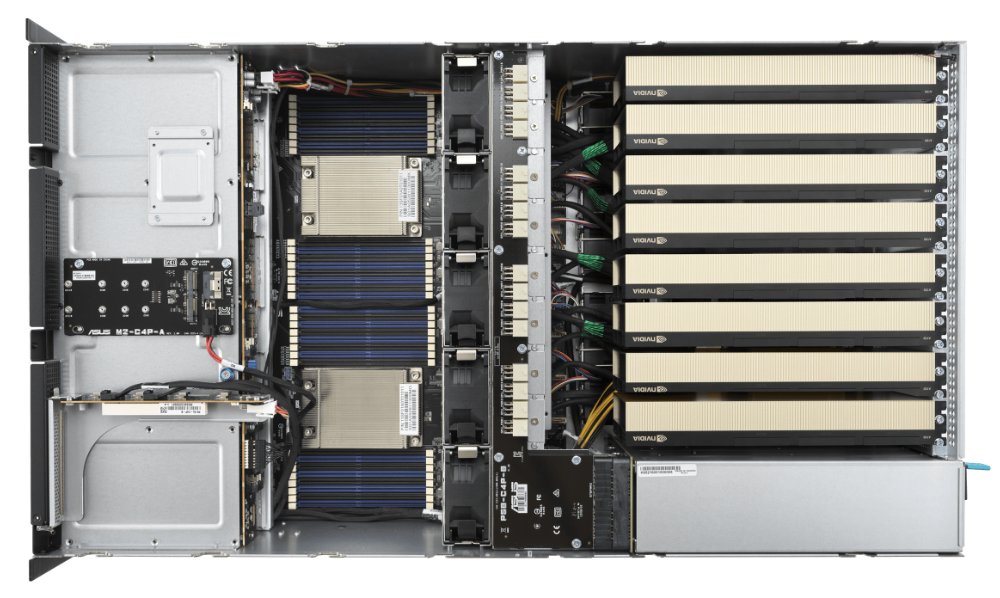

Der AIME A8000 basiert auf dem ASUS ESC8000A-E11 Barebone, das von zwei AMD EPYC™ Milan Prozessoren mit jeweils bis zu 64 Kernen betrieben wird - insgesamt liefert dieser Server also eine CPU-Leistung von bis zu 256 parallel rechnenden CPU-Threads.

Das auf multi-GPU-Betrieb ausgelegte Design, mit seiner effizienten Luftstromkühlung, ermöglicht die Verwendung von acht High-End-Double-Slot-GPUs, wie etwa NVIDIA A100, RTX 6000 Ada, RTX A5000 / A6000, RTX 3090 Turbo, Tesla oder Quadro GPUs.

Wählbare GPU-Konfigurationen

Wählen sie für die Konfiguration aus den leistungsfähigsten NVIDIA Deep-Learning GPUs:

Bis zu 8x NVIDIA A100

Die NVIDIA A100 ist das Flaggschiff der NVIDIA Ampere-Prozessorgeneration und der aktuelle Nachfolger der legendären NVIDIA Tesla Beschleunigerkarten. Die NVIDIA A100 basiert auf dem GA-100 Prozessor in 7nm Fertigung mit 6912 CUDA-Kernen, 432 Tensorkernen der dritten Generation und 40 oder 80 GB HBM2-Speicher mit den höchsten Datentransferraten. Eine einzelne NVIDIA A100 GPU sprengt bereits die Peta-TOPS-Leistungsbarriere. Acht Beschleuniger dieser Art summieren sich somit auf mehr als 2.000 teraFLOPS fp32-Leistung.

Bis zu 8x NVIDIA RTX 6000 Ada

Die RTX™ 6000 Ada basiert auf der neuesten NVIDIA-GPU-Architektur: Ada Lovelace. Sie ist der direkte Nachfolger der RTX A6000 und der Quadro RTX 6000. Die RTX 6000 Ada kombiniert 568 Tensor-Kerne der vierten Generation und 18.176 next-gen CUDA®-Kerne mit 48 GB Grafikspeicher für beispiellose Leistung für Rendering, Grafik und KI.

Bis zu 8x NVIDIA RTX A6000

Die NVIDIA RTX A6000 ist das Ampere-basierte Nachfolgemodell der NVIDIA Quadro Reihe. Sie verfügt über den selben GPU-Prozessor (GA-102) wie die RTX 3090, allerdings sind alle Kerne des GA-102 Prozessors aktiviert. Mit Ihren 10752 CUDA und 336 Tensor-Kernen der 3. Generation übertrifft sie die RTX 3090. Ausgestattet mit 48 GB GDDR6 ECC, die doppelten Menge an GPU-Speicher, im Vergleich zum Vorgänger der Quadro RTX 6000 und der RTX 3090. Die NVIDIA RTX A6000 ist derzeit zweitschnellste erhältliche NVIDIA-GPU, die nur von der NVIDIA A100 übertroffen wird. Sie eignet sich bestens für speicherintensive Anwendungen.

Bis zu 8x NVIDIA RTX A5000

Die NVIDIA RTX A5000 ist mit Ihren 8,192 CUDA und 256 Tensor-Kernen der 3. Generation weniger leistungsfähig als eine RTX 3090. Allerdings ist sie mit Ihrer 230 Watt Stromverbrauch und 24 GB Speicher eine sehr effiziente Beschleunigerkarte, insbesondere für Inferenz-Aufgaben eine interessante Alternative.

Alle angeboten NVIDIA GPUs unterstützen NVIDIAs CUDA-X AI SDK inkl. cuDNN und TensorRT und werden damit von allen gängigen Deep-Learning-Frameworks unterstützt.

Dual-EPYC-CPU-Leistung

Die High-End AMD EPYC Server-CPU arbeitet mit bis zu 64 Kernen und insgesamt 128 Threads pro CPU. Mit der Dual CPU Konfiguration sind 256 PCI 4.0-Lanes verfügbaren, somit können alle acht GPUs mit der maximalen Anzahl von PCI Lanes (x32) angebunden werden. Hierdurch wird die höchste Datenübertragungsrate zwischen den CPUs und den GPUs erreicht.

Der Datendurchsatz kann durch die hohe Anzahl verfügbarer CPU-Kerne erheblich verbessert werden, da hierdurch die GPUs optimal mit Aufgaben versorgt werden können, wenn diese für das Preprocessing und die Bereitstellung von Daten genutzt werden.

Bis zu 16 TB Hochgeschwindigkeits-SSD-Speicher

Beim Deep Learning müssen hohe Datenmengen verarbeitet und gespeichert werden. Ein hoher Datendurchsatz und schnelle Zugriffszeiten auf die Daten sind daher für schnelle Turnaround-Zeiten unerlässlich.

Der AIME A8000 kann mit bis zu zwei wechselbaren U.2 NVMe Triple Level Cell (TLC) SSDs mit einer Kapazität von jeweils bis zu 8 TB konfiguriert werden. Das ergibt eine Gesamtkapazität von 16 TB des schnellsten SSD-Speichers.

Jede der SSDs ist über PCI-4.0-Lanes direkt mit der CPU und dem Hauptspeicher verbunden und erreicht dadurch konstant höchste Lese- und Schreibraten von 3000 MB/s.

Wie im Serverbereich üblich haben die SSDs eine MTBF von 2,000,000 Stunden und 5 Jahre Garantie des Herstellers.

Höchste Konnektivität mit Managment Interface

Der A8000 kann mit bis zu 2x 100 Gbit/s (GBE) Netzwerkadapter für schnellste Verbindung zu NAS-Ressourcen und Big Data-Sammlungen ausgestattet werden. Auch in einem verteilten Computerverbund ist die höchste verfügbare LAN-Konnektivität ein Muss.

Der AIME A8000 ist über IPMI/BMC (AST2600) vollständig remote verwaltbar, was eine erfolgreiche Integration des AIME A8000 in größere Servercluster ermöglicht.

Optimiert für Multi-GPU-Serveranwendungen

Der AIME A8000 ist energieeffizient und bietet durch redundante Titanium-Netzteile einen ausfallsicheren Langzeitbetrieb. Seine Wärmesteuerungstechnologie ermöglicht einen effizienten Stromverbrauch in Server-Umgebungen.

AIME liefert den A8000 einsatzbereit vorkonfiguriert, optimiert auf Multi-GPU-Dauerleistung wie sie für Deep-Learning Anwendungen benötigt wird. Hierzu gehört auch ein vorinstalliertes Linux-Betriebssystem, mit aktuellsten Treibern und Frameworks wie Tensorflow, Keras, PyTorch und Mxnet, komfortabel verpackt in das AIME ML Container Management Framework.

Beginnen Sie sofort nach dem ersten Booten mit dem Training Ihrer Deep-Learning-Anwendung.

Technische Daten AIME A8000

| Type | Rack Server 4HE, 80cm Tiefe |

| CPU (konfigurierbar) |

EPYC Milan 2x EPYC 7313 (16 cores, 3.0 / 3.7 GHz) 2x EPYC 7413 (24 cores, 2.85 / 4.0 GHz) 2x EPYC 7543 (32 cores, 2.8 / 3.7 GHz) 2x EPYC 7713 (64 cores, 2.0 / 3.6 GHz) |

| RAM | 128 / 256 / 512 / 1024 / 2048 GB ECC Speicher |

| GPU Optionen |

1 bis 8x NVIDIA H100 80GB oder 1 bis 8x NVIDIA A100 80GB oder 1 bis 8x NVIDIA A100 40GB oder 1 bis 8x RTX 6000 Ada 48GB oder 1 bis 8x NVIDIA RTX A5000 24GB oder 1 bis 8x NVIDIA RTX A6000 48GB oder 1 bis 8x Tesla V100S 32GB |

| Kühlung | Dedizierte CPU Lüfter, GPUs mit 10 starken Hochleistungslüftern gekühlt > 100000h MTBF |

| Festspeicher | Bis zu 2x 15.36 TB U.2 NVMe PCIe 4.0 SSD Tripple Level Cell (TLC) Qualität 6800 MB/s lesen, 4000 MB/s schreiben MTBF von 2,000,000 Stunden und 5 Jahre Herstellergarantie bei 1 DWPD Optionales Hardware RAID: Bis zu 6x HDD 20 TB SATA RAID 0/1/5/10 oder Bis zu 6x SSD 7.68 TB SATA RAID 0/1/5/10 oder Bis zu 4x SSD 3.84 TB NVMe RAID 0/1/5/10 oder Bis zu 4x SSD 7.68 TB NVMe RAID 0/1/5/10 oder Bis zu 4x SSD 15.36 TB NVMe RAID 0/1/5/10 |

| Netzwerk |

1 x IPMI LAN 2 x 10 GBit LAN RJ45 oder 2 x 10 GBit LAN SFP+ oder 2 x 25 GBit LAN SFP28 oder 1 x 100 GBit QSFP28 |

| USB | 2 x USB 3.2 ports (vorne) |

| PSU | 2+2x 2200W redundante Leistung 80 PLUS Titanium zertifiziert (96% Effizienz) |

| Geräusch-Pegel | 88dBA |

| Abmessungen (BxHxT) | 440mm x 176mm (4HE) x 800mm

17.6" x 6.92" x 31.5" |

Betriebsumgebung | Betriebs-Temperatur: 10℃ ~ 35℃

Nicht-Betriebs-Temperatur: -40℃ ~ 70℃ |